MiteSens

Verbundprojekt: UAV-basiertes Monitoringsystem für Spinnmilben im Unterglasbau

Projektziele

Ziel des vom Bundesministerium für Ernährung und Landwirtschaft finanzierten dreijährigen Verbundprojekts MiteSens sind vor diesem Hintergrund die Forschungen und Entwicklungen (FuE) für ein UAS (Unmanned Aerial System) basiertes Monitoringsystem zur Früherkennung (Sensing) von pflanzenschädigenden Spinnmilben („Mites“, engl. Milben) in Gewächshäusern. MiteSens soll in der Lage sein, sowohl den frühen Befall von Pflanzenblättern mit Spinnmilben zu detektieren, als auch entsprechende Bekämpfungsmaßnahmen mit Prädatoren und/oder integrierbaren Pflanzenschutzmitteln (Akariziden) zu überwachen und deren Erfolg zu bewerten.

Methodik

MiteSens basiert auf bildgebenden Verfahren. In Verbindung mit einem UAS (MiteSens UAS) mit intelligenter Flugsteuerung (Flight Control) als Kameraträger sind grundsätzlich eine hohe raumzeitliche Auflösung des Spinnmilben-Monitorings, ein berührungsloser Einsatz sowie eine autonome Anwendung möglich.

Die Ableitung der nötigen Befallsinformationen (Ort, Stärke, raumzeitliche Dynamik des Spinnmilbenbefalls) aus den verorteten Bildinformationen basiert auf einem Machine Learning (maschinelles Lernen) Ansatz, der die entsprechenden Auswertungen in Echtzeit durchführt, somit eine schnelle Reaktion auf einen möglichen Befall ermöglicht und darüber hinaus bei verschiedenen Kulturen eingesetzt werden kann.

den 3D-Voxeldatenbestand.

Beitrag der HKA

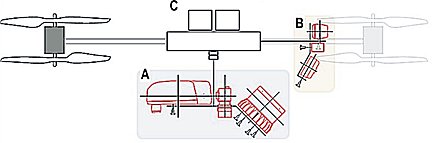

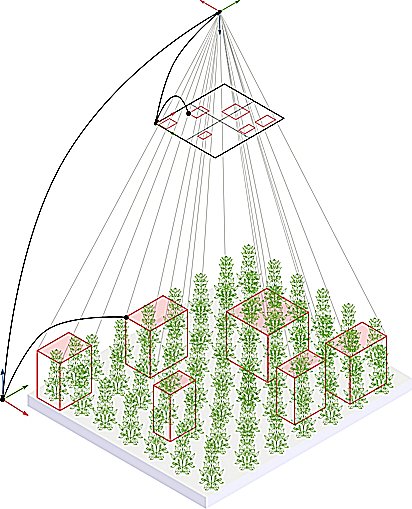

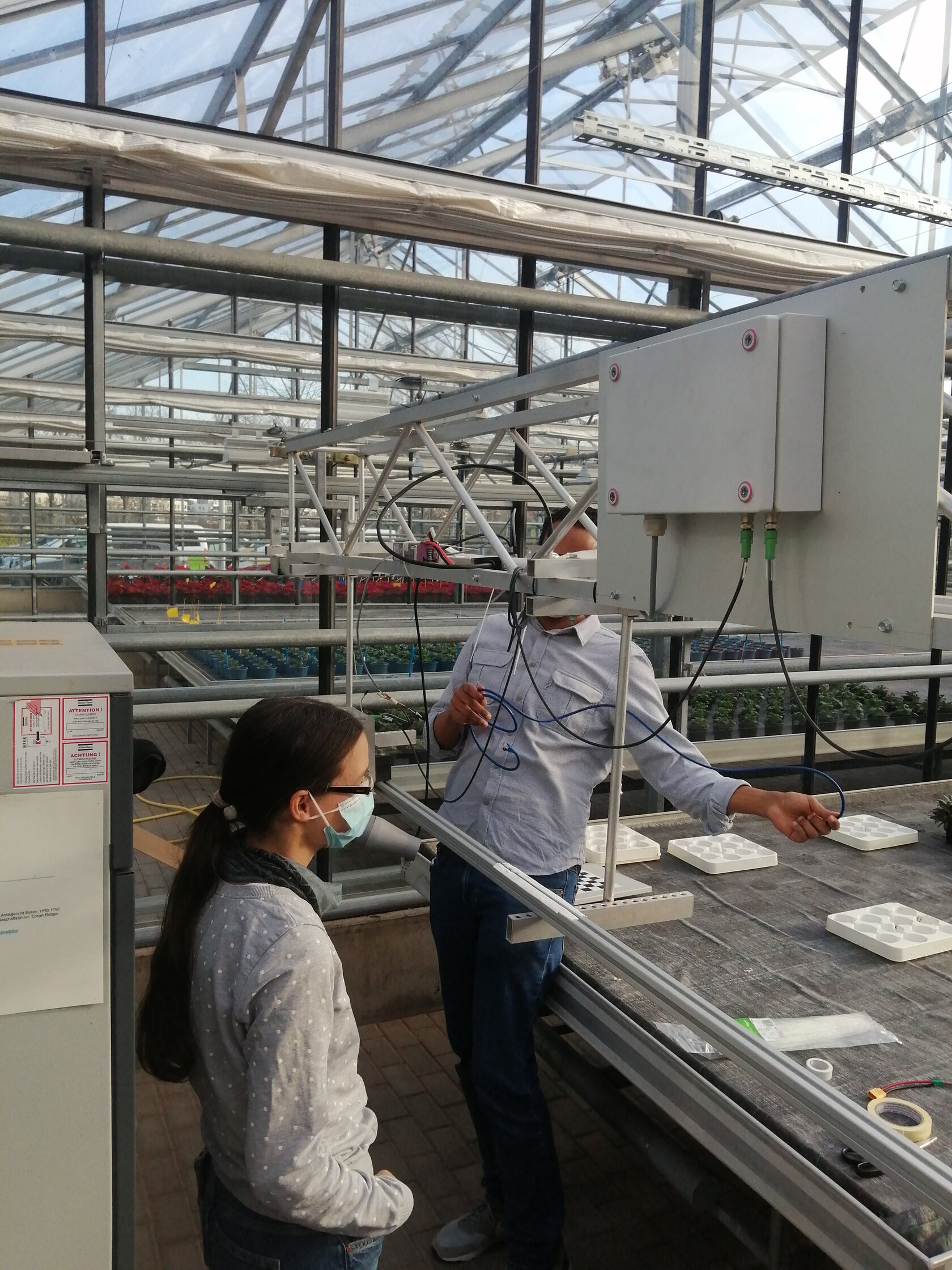

Die HKA widmet sich in direkter Zusammenarbeit mit der für den Teilbereich der UAV-Entwicklung zuständigen Multikopter GmbH & Co. KG im Labor für GNSS und Navigation im FuE Projekt MiteSens den Hard- und Softwareentwicklungen der UAS Sensorik, der UAS Flugsteuerung (FC) samt Ground Control Software und den Aufgaben der Photogrammetrie. Die intelligente FC für den autonomen UAS Indoorflug mit Hinderniserkennung und -umfliegung in Gewächshäusern basiert auf der algorithmischen Fusion der UAS Sensordaten von RGB-Kameras, Laserscanner, GNSS, Inertialsensorik, Inklinometer und Barometer (Abb. 1). Als Ergebnis der Sensordatenfusion resultiert der hochgenaue Navigationszustandsvektor. Der Navigationszustandsvektor und dessen hochgenaue Zeitsynchronisation aller Sensoren inklusive der Bilder der zur Milbendetektion auf dem UAS befindlichen Multispektralkamera (Abb. 1, Abb. 2) ist nicht nur der Schlüssel für die Navigations- und Steuerungskomponente der zu entwickelnden FC. Der zeitsynchronisierte Navigationszustandsvektor ist auch die zentrale Zustandsgröße für die FuE zur Photogrammetrie und Bildverarbeitung bei HKA bzw. Wolution.

Ziele und Beiträge der Partner

Zu den Photogrammetrieaufgaben der HKA gehören die über Kamera und Laserscanner vom UAS aus erfolgende 3D-Aufnahme und exakte 3D-Georeferenzierung des Gebäude- und Pflanzenbestandes. Die Gebäudegeoreferenzierung ist auch Voraussetzung für die Indoor-Flugnavigation des UAS über die Fusion der im Flug über Feature-Erkennung extrahierten koordinatenmäßig bekannten Gebäudeinformation bei der Navigationszustandsschätzung. Die FuE der HKA umfassen auch die Rückrechnung der nach Schädlingsbefall klassifizierten Multispektral-Einzelbilder auf den 3D-Pflanzenbestand und die Erstellung eines klassifizierten 3D Voxelmodell (Abb. 2). Dabei werden der Navigationszustandsvektor und dessen Zeitstempel für die Orientierung der Bilder benötigt (Abb. 2). Für die FuE-Methoden der Künstlichen Intelligenz (KI) und des Machine Learnings (ML) zur Schädlingsklassifizierung über die Multispektralbilder ist das Konsortiumsmitglied Wolution zuständig. Die Bilddatenverarbeitung hat dabei in Echtzeit zu erfolgen, um die rasche Einleitung von Pflanzenschutzmaßnahmen zu ermöglichen. Dies erfordert eine schnelle dezentrale Datenkommunikation zwischen den UAS-basiert erfassten und über den Navigationsstatusvektor georeferenzierten Multispektralbildern (HKA) und der erfolgten Bildklassifizierung (Wolution). Für das adäquate Cloud-basierte Edge-to-Cloud-to-Mobile Echtzeitdatenmanagement setzen die HKA und die Wolution GmbH & Co. KG den in der Land- und Ernährungswirtschaft favorisierten Datenbanktyp MongoDB ein.

Status

Laufendes Projekt 02/2020 — 03/2023

Kontakt

Projektleitung

Prof. Dr.-Ing. Reiner Jäger

Tel.: +49 (0)721 925-2620

reiner.jaeger@h-ka.de

Weitere Informationen zum Projekt MiteSens

Partner

Unter der Koordination des Instituts für Agrartechnik der Universität Hohenheim rekrutiert sich das Konsortium des FuE-Projekts „MiteSens“ aus dem Landwirtschaftlichen Technologiezentrum Augustenberg (LTZ), der Staatlichen Lehr- und Versuchsanstalt für den Gartenbau (LVG) Heidelberg, der Hochschule Karlsruhe (HKA), der Fa. Multikopter.de, der Fa. Wolution GmbH & Co. KG und dem Ingenieurbüro Bauer GmbH.

Projektförderung

Das Projekt MiteSens wird gefördert durch das Bundesministerium für Ernährung und Landwirtschaft (BMEL)